(报告出品方/作者:中信证券,杨泽原,丁奇)

核心观点:理解GPU的核心:性能先进性 生态计算壁垒。GPU物理性能取决于微架构、制程、流处理器数量、核心频率等,其中微架构是核心点。我们认为微架构的快速创新迭代是GPU性能领 先的前提,其图形渲染单元和通用计算单元设计向着“更多、更专、更智能”的方向优化迭代。根据应用场景来划分,数据中心要求强算 力、高并发吞吐量;游戏业务要求浮点运算能力强、访存速度快;图形显示要求图显专业化、精细化等。

生态:GPU生态构筑通用计算极深壁垒,Cuda生态占据大部分市场,类CUDA生态蓬勃发展。GPU生态由上层算法库,中层接口、驱动、 编译器和底层硬件架构三大部分基本构成。GPU研发难度在图形渲染硬件层面和通用计算软件生态层面,在IP、软件栈方面研发门槛较高, 需要较长的积累,先发优势明显。CUDA生态从2006年推出至今,经过不断发展完善,几乎已在行业生态内处于垄断地位,目前ROCm等 兼容Cuda的类计算生态蓬勃发展并处于快速推广阶段。

海外复盘:NVIDIA与AMD(ATI)的竞争贯穿GPU发展历程,架构创新升级和新兴AI等领域前瞻探索是领跑的关键。NVIDIA长期居于GPU市场领导地位,近年AMD凭借RDNA架构在游戏市场强势崛起。Verified Market Research数据显示,2022年全球独 立GPU市场规模约448.3亿美元,NVIDIA和AMD的市场份额占比约为8:2。根据JPR数据,NVIDIA凭借自身性能领先和CUDA生态优势性 始终占有GPU领域超50%的市场份额,数据中心业务更是全面领先,在游戏显卡领域,近年AMD凭借RDNA系列架构强势崛起。

NVIDIA先后与AMD等企业在性能方面竞争博弈,架构创新升级和新兴领域前瞻探索是领跑GPU行业的关键。NVIDIA凭借性能领先长期占 据超五成市场份额,AMD(ATI)也曾因架构出色、性能惊艳实现反超。同时NVIDIA早在2006年前瞻性布局通用计算、构建CUDA生态, 为如今AI&数据中心领域的全面领先构筑牢固的壁垒。NVIDIA积极布局异构芯片、汽车、元宇宙等新市场,寻找新的强有力业务增长点。

国内GPU市场:各应用场景市场广阔,国内厂商大有可为。需求端1—AI:数据中心和终端场景不断落地对计算芯片提出更多更高需求。新一轮AI对算力需求远超以往:ChatGPT类语言大模型底层 是2017年出现的Transformer架构,该架构相比传统的CNN/RNN为基础的AI模型,参数量达到数千亿,对算力消耗巨大,对算力硬件有大 量需求。甲子光年预测,中国AI芯片市场规模2023年达到557亿元。AI芯片可进一步细分为云端和终端,中国云端芯片市场规模较大,甲 子光年预计2023年增长至384.6亿元,对应复合年增速到52.8%;终端芯片市场规模甲子光年预计2023年增长至173亿元,对应年复合增 长率达62.2%,伴随各AI终端落地预计将保持较快增长速度。

需求端2—汽车:汽车智能化浪潮下域控制器GPU市场前景广阔。 自动驾驶和智能座舱是智能汽车中具有广阔前景的方向。盖世汽车数据 预计,2025年自动驾驶域控制器出货量将达到432万台,每台自动驾驶域控制器配备1-4片高性能计算GPU;智能座舱域控制器出货量达 到528万台,绝大多数智能座舱域控制器配备1片GPU。自动驾驶技术不断提高和座舱进一步智能化拉动汽车GPU市场规模快速扩张。 需求端3—游戏:游戏玩家人数持续增长,游戏GPU市场稳中有升。Newzoo Expert数据显示全球游戏玩家人数在2021年已达到30.57亿人, 且预计2020-2025年全球游戏玩家人数复合年增率为4.2%;游戏市场内,游戏机和PC两大主体出货量再创新高,游戏机三大巨头2021年 出货量高达4008万台;2021年Q4全球PC GPU出货量(包括集成和独立显卡)高达11000万片。

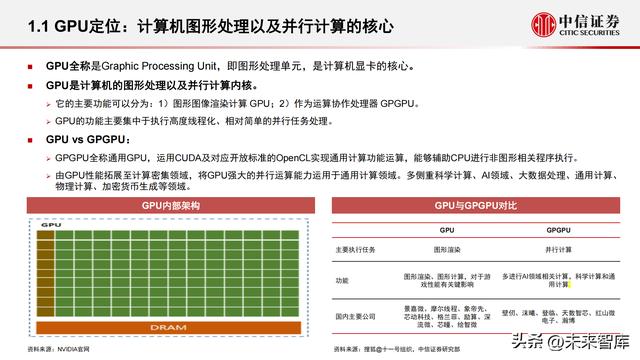

1、理解GPU的核心:性能 生态1.1、GPU定位:计算机图形处理以及并行计算的核心

GPU全称是Graphic Processing Unit,即图形处理单元,是计算机显卡的核心。 GPU是计算机的图形处理以及并行计算内核。它的主要功能可以分为:1)图形图像渲染计算 GPU;2)作为运算协作处理器 GPGPU。 GPU的功能主要集中于执行高度线程化、相对简单的并行任务处理。 GPU vs GPGPU:GPGPU全称通用GPU,运用CUDA及对应开放标准的OpenCL实现通用计算功能运算,能够辅助CPU进行非图形相关程序执行。 由GPU性能拓展至计算密集领域,将GPU强大的并行运算能力运用于通用计算领域。多侧重科学计算、AI领域、大数据处理、通用计算、 物理计算、加密货币生成等领域。

依据接入方式不同分为:独立GPU和集成GPU。1)独立GPU:大部分封装于独立显卡电路板上,使用PCIE接口和特定显存,不受空间和供电限制,性能相对更好、渲染画质更佳。主 要厂商包括AMD(Radeon系列)、NVIDIA(Geforce系列)。2)集成GPU:通常未拥有独立显存,集成于CPU内部,与CPU共同使用 Die和系统内存,节省空间占位和制作难度,价格较低、兼容性更佳且供电量少。主要厂商包括Intel(HD系列)、AMD(APU系列)。

依据应用端不同分为:PC GPU、服务器GPU和移动GPU。 1)PC端:集成GPU主要运用于提高轻办公效率,对性能要求较低;独立GPU主要运用于图形设计、提高图片制作清晰度以及3A游戏绘 图渲染能力,对性能要求较高。2)服务器端:主要进行专业可视化处理、AI训练、AI推断的深度学习、提高计算运行能力以及视频编解 码等功能,以独立GPU为主。3)移动端:提高游戏体验、提升游戏处理性能,应用场景包括AR、桌面、云计算、数据中心等。受移动 端功耗和体积限制,一般为集成GPU。

1.2、GPU性能影响因素:微架构、制程、核心频率

微架构:又称为微处理器体系结构,是硬件电路结构,用以实现指令执行。 制程:指GPU集成电路的密集度。在晶体管硬件数量一定的情况下,更精细的制程能够减少功耗和发热。现阶段GPU主 流最先进工艺制程为5nm。 核心频率:代表GPU显示核心处理图像频率大小/工作频率,能够反映显示核心的性能。

图形处理器单元数量:指GPU内部图形处理单元,涵盖光栅单元(ROP)和纹理单元(TMU)等数量。 光栅单元(ROP):进行光线、反射计算,负责游戏中高分辨率、高画质的效果生成。 纹理单元(TMU):能够对二进制的图形进行一系列翻转、缩放变化,再将其纹理传输至3D平面模型中。CUDA核数:作为GPU内部的流处理器,是主要的计算单元,CUDA核数越多,GPU性能等级越高。Tensor核数:能够进行张量核加速GEMM计算以及加速卷积和递归神经网络运行,Tensor核数越多,在人工智能、深度 学习领域的性能越强。

显存容量:显存作为GPU核心部件,用以临时存储未处理数据。 显存容量的大小对于GPU存储临时数据的多少起决定性作用,在GPU核心性能能够提供充足支撑前提下,越大的显存容量能够减少数据 读取次数,减少延迟出现。 显存位宽:是GPU在单位时钟周期内传送数据的最大位数,位数越大GPU的吞吐量越大。 显存频率:显存数据传输的速度即显存工作频率,通常以MHz为显存频率计数单位。 显存带宽:显存带宽=显存频率X显存位宽/8,为显存与显卡芯片间数据传输量。

PolyMorph Engine(黄色部分,多形体引擎),是全球首款实现了可扩展几何学流水线的重要元件。主要负 责顶点拾取(Vertex Fetch)、细分曲面(Tessellation)、 视口转换(Viewport Transform)、属性设定(Attribute Setup)、流输出(Stream Output)五个方面的处理工作。 在图形渲染流水线中: Vertex Fetch通过三角形索引取出三角形数据。 Viewport Transform负责模块处理已完成vertex-shader的所 有指令,进行裁剪三角形,准备栅格化。 Attribute Setup确保经过插值后的vertex-shader数据在pixelshader中的可读性。

微架构未来方向:更多、更专、更智能

更专:图形渲染能力更精细,通用计算能力更高效。 图形渲染领域:采用光线追踪技术,相较传统光栅化渲染方式,光线追踪采用基于物理渲染方式,使得所实现的效果更加接近显示,具 有更加逼真的图显能力。 通用计算领域:目前国际各大厂商均推出GPGPU计算解决方案,大规模扩展计算能力的高性能计算。例如:1)ATI Stream:为程序员 提供SDK开发工具包以协同进行GPU计算。2)NVIDIA CUDA:推出统一计算架构,由管线分工式设计转变为统一化的处理器设计,学 习成本较低,能够通过C、C 编程语言进行程序编写。

更智能:GPU AI运算能力上升。 GPU在AI领域得到广泛的应用,包括自动驾驶、医疗影像分析、人工智能计算能力、金融模型建立等领域,如第三代的张量单元相较于 上代在吞吐量上提升了1倍。 GPU自身结构特点决定其在AI的发展方向:1)多线程,计算单元数量多,并行计算方式能够同时计算大量数据。2)拥有更直接、迅速 访问缓存的能力。3)拥有更高精度的浮点算力,能够更佳适配于推理训练、深度学习。

应用场景:数据中心、游戏业务、图形显示、OEM、加密货币

GPU技术不断发展,GPU的应用场景也随之不断拓宽,不仅包含图形处理,还在AI、边缘计算等新领域发挥重要作用。 图形显示是GPU最基本的功能。GPU的诞生原因就是分担CPU计算量,凭借其处理并行计算的优势承担图像信息的运算工作。在游戏画面显示、图像运算等领域广泛应 用。 GPGPU被视为AI时代的算力核心。应用于人工智能场景的服务器通常搭载GPU、FPGA、ASIC等加速芯片。加速芯片和中央处理器的性能结合支撑高吞吐量的运算需求, 为图形视觉处理、语音交互等场景提供算力支持,已经成为人工智能发展的重要支撑力量。GPU由于在架构设计上擅长进行大量数据运 算,被广泛应用于人工智能计算中。在人工智能的应用和研究、智能安防、边缘计算、无人驾驶等领域发挥作用。

应用场景:人工智能芯片GPGPU、FPGA、ASIC的选择

GPGPU:为通用图形处理器,擅长图形处理,“粗粒度并行”技术。特点为拥有高灵活性、运用并行结构、在图形和复杂算法上效率较 高;缺点为价格贵且功耗高。 FPGA:为现场可编程逻辑阵列,擅长于算法更新频繁的专用领域。特点为灵活性适中、可以同时进行数据并行和任务并行计算、制作成 本低于ASIC、定制化、功耗低。在国内多用于芯片验证。 ASIC:为专用集成电路,应用于市场需求量大的专用领域。指应特定用户要求和特定电子系统的需要而设计、制造的集成电路,特点是 灵活性较低、高性能、成本高、可靠性高。缺点是算法相对固定、开发时间成本高。

1.3、GPU指令集:GPU进行图形渲染和通用计算的指令集合

GPU指令集本质是硬件执行功能的机器码。指令是计算机运行的最基本工作单位,是GPU功能实现的重要基础,通常包括指令格式、寻址方式和数据形式等。 GPU指令集是GPU中用以计算和控制系统的指令集合,指令集的先进与否直接关系到GPU性能的高低。操作系统通过指令集对硬件进行 管理和资源分配,并规范程序按认可方式编译运行。GPU指令集分类包括PTX、CUDA SASS指令集等。

指令集相关性质: 指令集本身在特定架构改变下会表现为指令性能变化,而本身的编码和功能并没有发生改变。 兼容性:经过CUDA C、C 编译完成后,会同时生成与SM单元对应的PTX和SASS代码。 指令执行吞吐是评价GPGPU执行的有效指标,GPU指令吞吐一般用每单位SM在一周期内执行的指令数量计算 SASS指令集分类:主要包括Predicate操作指令、Float指令、Integer指令、格式转化/数据移动/内存操作/跳转分支指令和Uniform DataPath指令。

MOV: 能够完成基本传送指令。MOV指令是编程中最基本的指令,能够将数据从起始源地址传送到目标地址。功能范围覆盖立即数传送、寄存器传送、储存器传送、段 寄存器传送。 MUFU: 作为SASS指令集中计算超越函数的重要工具。 超越函数指的是相对有限次加减乘除等组合而言,硬件上无法用多项式表示的函数需要通过该指令进行近似计算,若对精度有进一步要 求,还需要调用数学函数库中其他软件。完善的GPU生态体系能够兼容不同的软件、硬件平台,使得GPU性能得到最佳释放。GPU生态的由三大部分基本构成:1)上层图形引擎、算法库。2)中层标准API接口适配各类驱动、编译器。3)底层硬件/指令集架构。

GPU生态体系:构筑行业壁垒的基石

IP研发难度高: IP研发难度大、需要多年沉淀才能产出稳定性较佳的产品。目前GPU领域中,想要短期内产出需要依赖外部IP授权。市场上大多公司使 用Imagination提供的IP,即在购买商用GPU IP之后自行修改迭代。以苹果芯片IP专利为例,苹果在A10之前处理器芯片都是采用 lmagination的IP。 软件门槛高: 计算机芯片除了硬件之外,还要求有与之配套的软件体系,而GPU软件体系复杂,涵盖各类图形API、计算接口、基础库、应用对接适 配等等。NVIDIA在各类软件驱动测试上已投入大量时间,形成较强的生态效应。

规模化商用难:要实现规模化商用,就需要厂商实现软硬件技术生态完整部署。由于行业在生态建设上先发优势明显,NVIDIA通过早期与客户企业的平 台适配、软件开源合作,较好的用户体验加强了客户粘性,使新的竞争企业难以进行转移。市场认可度:市场认可度一方面需要生产商具备生产高品质产品的实力,另一方面需要用户经过一定时间使用形成反馈累积为企业信誉。在GPU市场 内,长期以来,AMD和NVIDIA两大产商占据了主要市场份额,也相应形成了较高的市场认可度,客户在选择产品时普遍优先考虑这两大 产商的产品;其他厂商的产品,由于未使用过且市场认可度不高,存在较大的不确定性,客户选购意愿较低。

2、他山之石:Nvidia/AMD竞争启示—架构创新升级和新兴领域前瞻探索是主旋律2.1、总览:NVIDIA经历风雨遥遥领先,AMD(ATI)再显峥嵘

总体而言,NVIDIA引领GPU行业发展数十年,大多数时期技术和市场份额均领先;AMD(ATI)长期与保持NVIDIA竞争, N/A卡之争愈演愈烈。 NVIDIA市场份额虽有波动,但长期高于50%,与其产品性能优势和生态构建优势密不可分。2006年起,英伟达GPU架构保持约每两年 更新一次的节奏。在这一节奏下,英伟达代际之间产品性能提升显著,生态构建完整,Geforce系列产品市占率长期超过Radeon镭龙系 列,NVIDIA牢牢把握市场龙头地位。2019年后,AMD凭借RDNA架构再度崛起。

NVIDIA、AMD(ATI)等企业构筑GPU发展主旋律

自1999年NVIDIA提出GPU概念,GPU已经有20余年发展历史。1995年,3Dfx发布第一款消费级3D显卡,拉开图形处理芯片的发展序幕。1999年,NVIDIA提出GPU概念,奠定其GPU行业霸主地位, 自此AMD、ATI、3Dfx等企业与NVIDIA合力推动GPU快速发展。 NVIDIA率先构筑通用计算的CUDA生态,引领GPU的行业革命;AMD(ATI)CPU、GPU双线并行紧随其后。如今人工智能高速发展,几乎应用于各行各业,GPU是目前应用最广的AI芯片。NVIDIA把握游戏、数据中心市场机遇;AMD加速提升架 构性能紧随其后。

AMD:ATI时代开端奠定市场基础

AMD显卡发展可大致划分为两阶段:第一阶段ATI时代从1985年至2006年,第二阶段从2006年至今为AMD时代— Radeon系列持续迭代更新。自早期开始,AMD分为两路研发,兼顾高端显卡市场和低端显卡市场,其中,高端产品如Radeon 8500、Radeon X1800 XT等;从高端 显卡中衍生出多款低端显卡产品,包括Radeon 9000、9000 Pro、9100、9200以及9250。2012年以来,AMD在架构上保持创新态势,制程引领行业先进性。2012年发布Radeon HD系列,AMD在架构上实现创新,推出GCN架构,并且是业界第一款采用28纳米工艺制程的GPU图形芯片。在图 形渲染和通用计算领域性能均领先市场内竞争对手。 2019年,AMD推出RDNA架构,同时兼容原有GCN架构,在性能、功耗、能效等多方面实现超越,正式开启第五代架构革新之路。

2.2、1962-1995年:图形处理技术不断发展,3Dfx凭Voodoo一枝独秀

1962年起,计算机图形学不断发展,图形处理技术实现从2D到3D的突破。1962年麻省理工学院博士伊凡•苏泽兰奠定了计算机图形学基础;1984年,SGI公司推出了面向专业领域的高端图形工作站,俗称图形加 速器,是首个专门的图形处理硬件。1994年,3D Labs发布GLINT 300SX, 是PC最早的3D硬件加速图形芯片,从此开启3D显卡时代。1995年,3Dfx发布Voodoo图形芯片组配和Glide API接口,一度统治市场。Glide是3Dfx为Voodoo打造的底层3D API,是第一个在PC游戏领域得到大范围使用的程序接口,使得Voodoo无须硬件厂商额外提供API 就可以直接开发游戏,具有易用性和稳定性。NVIDIA同期的riva 128性能与其有差距。 当时的顶级游戏和部分PC游戏基本都支持Glide。因此即使Voodoo的价格远远高于市场上其他产品,也深受消费者追捧。

3Dfx Voodoo系列后续产品被NVIDIA反超,开始由盛转衰。1996年,3Dfx凭借Voodoo成为全球3D显卡和GPU制造领域的垄断者。1997年,NVIDIA推出的NV 3(RIVA 128)有128bit的2D、3D加 速图形核心,采用0.35微米工艺,支持微软Direct 3D接口,且性价比高于Voodoo,被OEM厂商广泛使用。 1998-1999年,NVIDIA推出NV4性能击败Voodoo3,随后3Dfx的Voodoo4延迟发布、Voodoo5由于能耗大、散热高败给NVIDIA。

1999年8月,NVIDIA公司发布图形芯片Geforce 256,首次提出GPU的概念。Geforce 256采用技术包括硬件变换、“T&L”、立方环境材质贴图和顶点混合、凹凸映射贴图、双重纹理四像素256位渲染引擎、纹理压 缩等,兼容Direct X和Open GL,被称为世界上第一款GPU。此前如顶点变换必须在CPU中完成,光栅化后像素有限等,而GPU将这些 功能独立出来,使显示核心与CPU并列成为计算机核心,大大减少CPU的运算压力。

1999年,NVIDIA崛起,击败并收购难以为继的3Dfx 1999年,NVIDIA的Geforce 256奠定了NVIDIA在GPU市场的领先地位。与此同时的3DFX由于一系列决策失误,由盛转衰。 2000年12月15日,Nvidia低价收购3Dfx图形处理相关所有产业。 3Dfx的失败可以归因于战略和产品策略问题 战略失误:芯片厂商涉足板卡制造领域面临困难。3Dfx收购板卡制造商STB,希望独自生产Voodoo显卡,但二者的合作并没有表现出 1 1>2的效果,反而拖慢新品发布进度,令3Dfx丢掉不少市场份额。同时失去原有板卡厂商合作伙伴,DIAMOND、GIGABYTE、 CREATIVE、ELSA都加入NVIDIA阵营。

产品策略问题:Voodoo3与Voodoo2相比性能进步很小,只是换了马甲;Voodoo4和Voodoo5不支持硬件转换和TV输出功能,失去了DVD 和家庭影院市场;Voodoo4和Voodoo5不支持DDR内存,而自身适配的SDRAM在性价比上输给NVIDIA的DDR内存,再次流失市场份额。

2000年显卡市场格局洗牌,ATI凭Radeon 9700强势崛起。2000年,ATI发布Radeon 256,180nm工艺,内有3000万颗晶体管,具备在当时属于先进技术的几何变形、图像剪切功能、光照效果, 性能优于Nvidia同代的Geforce 256。自此,PC端独立显卡市场形成Radeon系列与Geforce系列对峙的局面。2002年,ATI发布R 300(即Radeon 9700)支持DirectX9.0、4顶点着色器、8像素流水线、256位DDR内存总线;2003年发布Radeon 9800pro,性能均超过Nvidia的Geforce FX5900。ATI逐步站稳脚跟。随后NVIDIA的Geforce FX6800又在性能反超Radeon 9800。在此 之后,ATI真正与Nvidia在GPU市场平分秋色,二者产品性能相互追赶。

NVIDIA遇强力对手,市场份额跌破50%;ATI获微软XBOX 2主机图形芯片订单。在ATI Radeon 9700和XBOX 2 订单的帮助下,ATI市场份额最高达到55%,而NVIDIA市场份额跌破50%,为NVIDIA迄今为止最低点。 微软和Nvidia共同研发微软第一代XBOX的图形处理器芯片,而2003年ATI获得第二代XBOX的图形处理器订单,股价因此由上涨1美元到 13.2美元,并在2004年顺利完成该订单显卡的开发工作,市场份额有所上涨。

自2006年起,英伟达GPU架构保持约每两年更新一次的节奏,代际之间产品性能提升显著,性能和市场份额均领先AMD。 2006年,英伟达推出了CUDA编程软件,使GPU成为通用并行数据处理加速器,并逐步构筑起CUDA生态。 CUDA让显卡可以用于通用并行计算和其他非图形计算,使得GPU能够承担和CPU一样的计算任务。程序员可以通过CUDA直接对GPU 进行编程。为NVIDIA的数据中心业务高速扩张打下基础。 CUDA包括硬件平台和软件栈(软件集合)两层含义,加上第三方应用及工具的扩展,形成从开发到应用的CUDA生态。CUDA生态也成 为NVIDIA的生态护城河。

架构创新升级和新兴领域前瞻探索是领跑GPU行业的关键。NVIDIA坚持每两到三年完成一次架构迭代,持续保持领先的图显和计算性能:2001年发布Kelvin,2003年发布Rankine,2004年发布 Curie,2006年发布Tesla,2009年发布Fermi,2012年发布Kepler,2014年发布Maxwell,2016年发布Pascal,2017年发布Volta,2018 年发布Turing,2020年Ampere,2022年先后发布Hopper和Ada lovelace。架构创新迭代高效,架构之间性能提升显著。而AMD(ATI) 也曾凭借Radeon 9700、Radeon 9800强势崛起,近些年的RDNA架构也令其市场份额快速提高。

NVIDIA前瞻性布局新兴领域数据中心、自动驾驶等领域,推动业绩爆发增长。其自2006年开始构筑CUDA生态并推出Tesla通用计算 GPU架构,从以硬件为核心的企业变成以软硬件平台为核心的科技公司,前瞻性的布局使其在计算生态上构筑了极深的壁垒,占据了绝 大部分市场。近年公司开始布局元宇宙等领域,持续探索新兴领域以保持GPU行业的龙头地位。

未来竞争:NVIDIA维持游戏和数据中心领先地位,同时瞄准元宇宙、智能汽车市场

NVIDIA各主要业务线持续发力,以技术创新技术保持行业领先,开启元宇宙布局。游戏:NVIDIA新发布Ada Lovelace架构的4000系列GPU有极强的光追性能,比前代提高1-3倍,性能显著领先AMD,但成本也显著提高。汽车:在2022 GTC大会上发布的NVIDIA DRIVE Thor SoC系统,算力达到2000TOPS,公司计划在2025年装车。Thor可以将智能汽车 的所有功能集成在单个AI计算器上,将显著降低成本,对智能座舱领域将是颠覆性影响。元宇宙:Omniverse是为元宇宙打造的软硬件方案,彰显其在元宇宙领域提前布局的野心。使用者可以在Omniverse中创建虚拟世界,而 他们所创建的虚拟物体也会成为NVIDIA元宇宙生态的重要组成部分。与NVIDIA的GPU、CPU等硬件基础一起,共同构成NVIDIA元宇宙 的一站式云服务体系。

云端芯片市场格局未定,NVIDIA实行“GPU CPU DPU”路线,布局云端异构AI芯片。2021年的GTC大会NVIDIA推出面向数据中心AI和高性能计算的自研的采用ArmNeoverse架构的Grace芯片。并取得ARM授权协议,可开 发ARM架构CPU芯片。2019年,NVIDIA以70亿美元收购Mellanox,2020年推出BlueField-2 DPU,成功布局DPU业务。

未来竞争:AMD结合自身CPU优势全方位布局AI芯片

2022年6月19日,AMD讲述其未来发展战略,概述为技术和产品组合更新、扩大数据中心解决方案产品组合、加速打造 无所不在的 AI 领域领导地位、扩大PC领先、推动图形解决方案发展势头。 AMD结合CPU优势,GPU、FPGA、APU业务多点布局抢占AI芯片行业先机。AMD希望未来将更多AI功能引入CPU的硬件层面中,如AVX-512 VNNI指令集。AMD认为,在CPU中运行大部分推理很重要并会是未来 趋势。AMD预计明年发布全球第一个数据中心APU——Instinct MI300(此前该系列为GPU加速卡),面向训练领域,结合使用Zen 4架 构的CPU和CDNA 3架构的GPU。APU是将处理器和独显集成到一个晶片上,实现GPU和CPU的融合。 AMD收购Xilinx(赛灵思)以更好地开展FPGA业务,补全FPGA领域的短板,扩大自身AI芯片市场。

3、国内市场:GPU细分市场前景广阔,国内厂商大有可为3.1、GPU市场空间广阔,国内企业规模逐步起量

2022年全球GPU市场规模达到448.3亿美元,国内外市场空间正高速增长,年复合增长率达到32.8%。Verified Market Research 数据显示,2020年,全球GPU市场规模为254.1亿美元,且该机构预计2028年市场规模将达到2465.1亿美元, 对应年复合增长率达32.8%。

国际独立GPU市场由Nvidia、AMD八二分成,国内市场中国企业体量快速增长 。 国际市场上,英伟达、AMD瓜分市场,Jon Peddie Research数据显示2022Q1英伟达占据79%市场份额,AMD占据21%。英伟达在独立 GPU领域一枝独秀,AMD在集成GPU领域可与英伟达竞争。国内GPU龙头企业景嘉微2022年上半年营业收入5.44亿人民币,2021年营业收入10.93亿人民币;2022年上半年海光 信息营业收入为25.3亿元,而英伟达2022Q2营收为67亿美元,2021年NVIDIA中国区的营收约为71亿美元。相比之下,国产厂商相对规 模暂时较小,未来成长空间广阔。

GPU应用场景不断扩大拉动GPU市场空间迅猛增长,根据Verified Market Research预测,2027年中国GPU市场规模将 会增长至345.57亿美元。GPU市场主要应用场景可概括为:AI&数据中心、智能汽车、游戏。 AI&数据中心:新一轮AI对算力需求远超以往:ChatGPT类语言大模型底层是2017年出现的Transformer架构,该架构相比传统的 CNN/RNN为基础的AI模型,参数量达到数千亿,对算力消耗巨大,对算力硬件有大量需求。随着对商业数据和大数据处理要求算力的不 断提高,GPU的通用计算能力正在越来越广泛地被应用与数据中心和国家超算中心的建设。 智能汽车:智能汽车方兴未艾,自动驾驶和智慧座舱是智能汽车发展的主要方向,均需大量使用GPU。游戏:游戏业务是GPU应用的传统领域,对游戏画面进行3D渲染,英伟达的游戏业务稳中有进。

3.2、AI:ChatGPT等AI大模型加速对大算力的需求

ChatGPT 模型引发市场关注,对话类AI效果超大众预期,大模型需要更大的算力。 2022年11月人工智能实验室 OpenAI 推出了一款AI对话系统—ChatGPT,ChatGPT模型从 GPT-3.5 系列中的一个模型微调而成,并在 Azure AI 超级计算基础设施上进行训练,能够进行有逻辑的对话、撰写代码、撰写剧本、纠正错误、拒绝不正当的请求等,效果超越大 众预期。这标志着对话类人工智能可以在大范围、细节问题上给出较合理准确的答案,并根据上下文形成一定像人类一样有逻辑且有创 造力的回答。 ChatGPT的优化主要来自模型的增大,以及因此带来的算力增加。GPT、GPT-2和GPT-3(当前开放的版本为GPT-3.5)的参数量从1.17 亿增加到1750亿,预训练数据量从5GB增加到45TB,其中GPT-3训练单次的成本就高达460万美元。

依据部署位置划分,AI芯片可以细分为终端芯片和云端芯片,云端芯片市场空间越为终端芯片的2-3倍。云端芯片:云端芯片应用于云端服务器,可以进一步细分为推理芯片和训练芯片。根据甲子光年数据,2018年中国云端芯片市场约46.1 亿元,该机构预计2023年增长至384.6亿元。 终端芯片:应用于嵌入式、移动终端、智能制造、智能家居等领域的AI芯片,终端芯片需要低功耗和更高的能效比,但是对算力的需求 也相对较低,主要应用与AI推理。根据甲子光年数据,2018年中国终端芯片市场约15亿元,该机构预计2023年增长至173亿元。

AI芯片总市场232亿元,其中云端芯片市场空间更大,预计终端芯片将随着AI在多行业落地将进一步放量。甲子光年预测,中国AI芯片市场规模将从2021年232亿元增长至2023年的500亿元左右,对应中国云端芯片市场的复合增长率为52.8%; 终端芯片市场规模相对较小,但由于人工智能在汽车、安防、智能家居等行业渗透,届时市场规模增长率达到62.2%。

汽车智能化浪潮下汽车GPU市场前景广阔—自动驾驶

汽车智能化浪潮下,自动驾驶和智能座舱是最具有发展前景的两个方向,GPU应用于二者的域控制器 GPU两大功能助力自动驾驶。智能汽车主流的域控制器采用SoC与MCU结合的方案,SoC(片上系统) 由GPU、CPU、AI引擎、DPU等组成。GPU在自动驾驶中的 作用表现在图形处理和并行计算,ADAS 平台可以利用 GPU 的并行计算能力实时分析来自激光雷达、雷达和红外摄像头的传感器数据。 盖世汽车预计到2025年中国自动驾驶域控制器出货量达到432万台。自动驾驶域控制器与SoC之比在1:1到1:4之间,市场份额较高的SoC通常搭载一片GPU。

3.3、汽车智能化浪潮下汽车GPU市场前景广阔—智能座舱

GPU虚拟化技术助力智能座舱一芯多屏化发展。智能座舱芯片主要为SoC(片上系统),SoC由GPU、CPU、AI引擎、DPU等组成。 智能座舱向着一芯多屏的形态发展,这对芯片并行计算的要求不断提高,GPU硬件虚拟化技术在智能座舱中有着无可替代的优势。在智 能座舱屏幕、仪表盘、车载与各系统中均需要使用GPU。 盖世汽车预计2025年中国智能座舱域控制器出货量达到528万台。智能座舱一台域控制器内置一个SoC,位于汽车的中央显示屏内,一个SoC通常搭载一片GPU。

游戏市场是传统意义上GPU最关键的市场。随着千禧一代游戏需求的进一步提升,全球游戏玩家数量稳增,相应地扩展了游戏GPU市场规模。Newzoo Expert预计2020-2025年全 球游戏玩家人数复合年增率为4.2%。 游戏GPU的主要分类。根据现行市场上的主要产品可划分为四类:1)游戏机、2)PC端主机游戏、3)控制台、4)VR&AR。

PC游戏市场主体 PC指单机电脑、个人电脑。PC端游戏是通过计算机进行相关操作,实现人机交互的游戏方式。根据Jon Peddie Research统计,2021年Q4全球PC GPU出货量(包括集成和独立显卡)高达11000万片。受到俄乌冲突、天然气供应等 冲击性全球事件影响,2022年Q1、Q2,全球PC GPU出货量略有下降。GPU与PC配售比。配售比指GPU与PC主机的整体采用率,由于PC正常运行必须要求硬件上同时具备CPU和GPU,因此每台PC至少需要一张集成显卡或独 立显卡,此外,根据需求可再增购独立显卡。根据JPR统计,全球GPU与PC配售比在2022Q1达到了129%。

报告节选:

(本文仅供参考,不代表我们的任何投资建议。如需使用相关信息,请参阅报告原文。)

精选报告来源:【未来智库】「链接」

,