选自Scientific American

作者:Gary Marcus

机器之心编译

参与:李泽南、黄小天、曹瑞

摘要

-

在人们心中,艾伦·图灵的「模仿游戏」(一台机器作为被测试者试图说服一名人类测试者自己是人而不是机器)长久以来被认为是人工智能的终极测试。

-

图灵测试虽没有完全过时,但目前通过测试的 AI 借助的多是欺骗而不是真正的智能。人工智能专家宣称,是时候用一系列方法取代图灵测试了,这些方法可以全方位评估人工智能。

-

真正的智能机器应能够理解含糊不清的表述,把零件拼装成家具,通过人类四年级的科学考试,甚至更多。这些任务对于机器的困难程度充分证明:抛开炒作不谈,人类水准的人工智能依然遥不可及。

1950 年,艾伦·图灵发明了一个迄今为止仍被称为人工智能终极测试的思想实验,它被称为「模仿游戏」,也就是后来广为人知的图灵测试。通过假定存在一个可以把自己伪装成人类的计算机程序,我们现在称之为聊天机器人(chat bot),图灵设想了一个测试:机器施展自己的能力试图说服一个人类测试者自己是人类,它需要回答有关诗歌的问题,甚至故意在计算问题上出错。今天,在大众眼中,图灵测试常被看作一种界限,一种测量机器智能是否真正到来的手段。但它不应该如此:界限可以被通过——有时出于错误的原因。虽然短期内看,机器有可能骗过人类,但这种胜利很快会化为泡影,它们不太可能引出真正的人工智能。

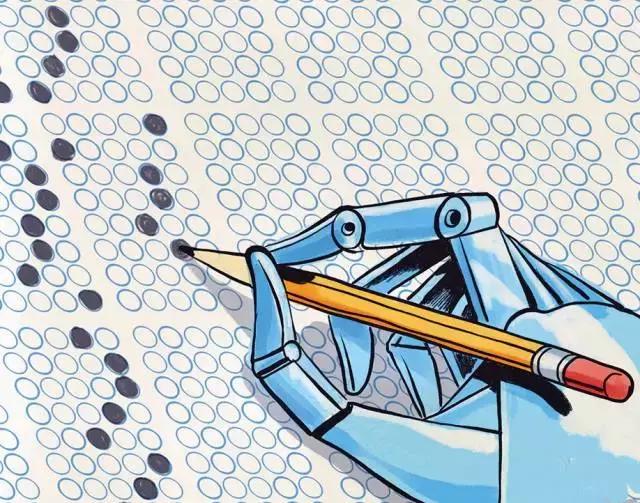

测试 02:人类的标准化测试

人工智能将接受人类学生在小学、中学阶段面临的考试,不给任何宽限。这一方法是将语义理解和解决各类问题的任务联系在一起的绝妙方式。这很像是图灵测试,但前者更加简单直接。只需让人工智能接受严格的标准化测试(如纽约市四年级科学考试的多选题),为机器配备足够的输入能力(如自然语言理解和机器视觉模块)然后开始考试吧。

优点:多样化且务实。和 Winograd 模式不同,标准测试相对简单易行。而且因为没有任何一种人类考试是为机器准备的,所以考题非常丰富,而有关常识的问题需要进行阅读理解,有可能不存在独一无二的答案。

缺点:不像谷歌背书的 Winograd 模式,这种测试面向人类,而且通过标准化考试并不一定意味着机器具有了「真正的」智能。

难度:中等。此前,由 Allen 人工智能研究所设计的 Aristo 系统在接受未遇到过的四年级科学考试时可以获得平均 75%的分数。但那些试卷上都是没有图片的多项选择题。「目前还没有哪个系统能通过完整的四年级科学考试,」Allen 研究所的科学家在 AI Magazine 中写道。

为何适用:解决现实世界的问题。「我们可以看到,目前还没有哪个系统能够在 8 年级的科学考试中取得及格的成绩,但同时,我们又能看到 IBM Watson 帮助医学院的研究人员攻克癌症的新闻,」Allen 人工智能研究所的首席执行官 Oren Etzioni 说道。「IBM 可能有了惊人的技术突破,也可能他们只是在某个方面稍稍领先。」

测试 03:物理图灵测试

大多数机器智能的测试方式集中在认知方面。而这个测试更像是实践课:人工智能必须以有意义的方式在现实世界完成任务。这一测试分为两个方向。在构建方向,一个具有实体的人工智能——机器人必须学会阅读使用说明,将一堆部件组装成实体(就像从宜家买回家具自己拼装一样);而探索方向则是一个开放的问题,需要人工智能发挥自己的创造力,使用手头的积木来完成指定的任务(例如「建一堵墙」、「盖一个房子」、「为房子加盖一个车库」)。这两个方向都要求被测试的机器理解任务内容,找到解决方法。这种测试可以面向单独的机器人,也可以面向机器人群组,甚至人类和机器人共存的小组。

优点:这一测试模拟现实世界中智能生物需要解决的问题——特别是在感知和行动方面,这是以往人工智能测试方法所或缺的。另外,这种测试很难作弊:「我不知道它存在什么技巧,除非有些人能够找到办法让人工智能在网上搜索出已经存在的类似建筑物。」Nuance 的 Charles Ortiz 说道。

缺点:繁琐、乏味且难以自动进行,除非机器可以在虚拟现实场景中进行测试。而且即使这样可行,「机器人学家也会说(虚拟现实场景)只是近似的环境,」Ortiz 说道。「在现实世界里,如果你拿起一个组件,它可能会滑落,这或许是一个易于解决的问题。但在 VR 世界中很多条件都可能存在细微的差别。」

难度:科幻级。一个具有实体的人工智能可以自然地操纵物体,并能连贯地解释自己的行为——这不就是《星球大战》里的机器人吗。「让机器人能像儿童一样掌握这种能力是一个巨大的挑战。」Ortiz 说道。

为何适用:想象一下通往人工智能的道路,有四个问题需要解决——感知、行动、认知和语言,而现在的研究计划往往只专注其一。

测试 04:I-Athlon

在一次部分或完全自动测试中,让人工智能总结音频文件中的内容,叙述视频中发生的情节,即时翻译自然语言同时执行其他任务。这是为了构建一个客观的智能分数。其中,没有人监督的自动化测试是这一方法的重点。将人类从评估机器智能的过程中剔除是一个有点讽刺的事,但 IBM 的人工智能研究者 Murray Campbell(前「深蓝」开发成员)表示:对于人工智能的测试必须保证有效且可复现。建立一个算法来生成 AI 的智能分数也可以让研究者们不用再依赖于「肯定存在认知偏差」的人类智能,它可以像标尺一样具有统一的刻度。

优点:至少理论上客观公正。一旦 I-Athlon 进行了测试并给出了评分,计算机会得到相应的评分和加权对比。它的判断就像审查奥运会比赛冲线照片一样公正。这种测试的多样性也符合 IBM 研究者称之为「广义智能系统」的标准。

缺点:潜在的不可预见性。I-Athlon 算法可能会给人类研究者无法完全理解的人工智能系统打个高分。「如果一个人工智能系统(对人类而言)非常难以解释,这种事情很有可能发生,」Campbell 解释道。事实上,这一有关打分的黑箱问题在卷积神经网络中已经在困扰着研究者了。

难度:未知。目前的系统在一些潜在的 I-Athlon 任务上表现的不错,如图像识别和语言翻译方面。在另一些任务中,如对视频内容进行解说或对图标进行讲解方面,人工智能仍然远远不能胜任。

为何适用:这种方式可以减少人类认知偏见对测量机器智能和量化工作的影响,而不是简单地测试性能。