以前的互联网有三大特征:开放、分享与和谐。

网友们上网可快乐了,在贴吧找到自己的兴趣部落,在论坛找自己想要的资源...

拿到资源后,网友还会满怀感恩地说一句:“谢谢楼主,好人一生平安。”

现在就不一样了,有了手机这玩意儿后,上网的门槛低了不少,网络上也出现了很多键盘侠。

他们游走在各大游戏和论坛,对着自己不满的观点暴力输出,一秒十行。

从以前的二话不说问候双亲,到现在的句句不离阴阳怪气,形式变了,但他们作为键盘侠的底气没变。

除了键盘侠,网络上还有一种极其影响风气的人,小雷称之为卖片怪。

字面意思,就是在网络各个角落,想尽办法卖黄片赚钱的黑产商。

还有一种行为更离谱,如果大伙有关注一下抽象博主(大篮子、孙笑川等)。

你会发现,他们的每条微博下,必会出现《无内鬼》环节。

《无内鬼》环节是一片禁忌之地,里面会有各种18禁图,运气好是黄图,运气不好会引起生理不适。

So,小雷又称之为试胆环节。

当然啦,喷人和搞黄色都会影响网络风气,所以大厂们一直在加大力度监管。

大部分情况下,那些黄图和辱骂文字都会被和谐,但茫茫大海总会有漏网之鱼。

这时候就需要我们正义网友重拳出击,遇到有人搞黄色时,积极举报。

如果实在不确定某张图有没有搞黄色,那小雷就得掏出一个好东西给你们用了。

喏,就是这个“在线图片鉴黄工具”。(恶搞向)

真鉴黄还是套白狼?工具会按照性感、涩情和变态三个成分来鉴定,帮大家区分图片属性。

打开网页,示范图片居然是近期的鬼畜红人“杰哥”,看来开发者是老玩梗达人了。

使用方法也非常简单,只需把自己想要识别的图片上传,杰哥很快就能鉴别出是不是黄图。

先上传一张老婆冰冰的自拍,检验一下它的能力。

不到一秒,系统就给出了答案,84%的概率是普通图片,14%的概率是黄色图片。

其实这图片跟黄色压根不着边,不过考虑到是AI嘛,也能理解。

接着,小雷又把最近很流行的表情图上传,系统的检测依然准确。

99%的概率是普通图片,一点黄色成分都没有。

辣么,来张美女短裤照片又怎么说?

emmm...这次鉴定貌似翻车了,也反映出网站的AI检测还不太成熟。

性感占比47%,这个还算有依据,但色情占比高达45%就离谱,总不能穿条短裤就是搞黄色叭...

再来点尺度拉满的,把前段时间爆火的肌肉金轮放上去,大伙说有没有搞头?

小雷刚把图片上传,网页背景色从绿色秒变为棕红色,空气中弥漫着紧张的气氛。

一看分析...好家伙,85%的概率是黄色,还有性感、普通和变态等元素。

抛开玩梗不说,这波分析非常到位,图片确实包含了这几种元素,猎奇得很。

当然,这样的鉴定工具也有翻车的时候。

遇到难以识别的图片时,鉴定器就会脑子短路,给出与实际完全不符的分析结果。

喏,就这么一个人畜无害的表情包,居然能给出含黄量高达85%的分析。

还有这个可爱的猫咪,怎么看都和色情不搭边,但鉴定器却给出极高的含黄量。

不能说没有关系,只能说是毫不相干了。

要是全网的图片审核,都以这个在线黄图鉴定器为标准,那网络上90%以上的图片都得被整顿...

不过还是那句话,开发者做出这样的在线工具,估计也是恶搞为主。

因为在网页的底部有这么一句话:“上传的图片我会定期检查,提前谢谢了。”

这波啊,这波是空手套白狼,连开发者自己都亲口承认。

So,与其较真,小雷更愿意去研究一下,网站是如何鉴定黄图的。

AI鉴黄,还差点意思从小雷这十几分钟的体验来看,这个网站应该有经过简单的AI图像训练。

毕竟好几张图片都给出了比较精准的鉴定,识别率是在线的。

但翻车次数也不少,特别是猫咪图,很容易被识别为搞黄色。

而所谓的AI鉴黄,又是个啥原理?它又能不能完全代替人工审核?

早期AI还没出现的时候,网络上的各种图片真就全靠人工审核,非常考验鉴黄师的经验和抗压能力。

连续值班七八个小时就盯着黄暴污图片来审核,轻则头秃,重则抑郁。

就拿以前官方扫黄那事儿来说,当时警方查获了一个淫秽论坛,期间需要鉴黄师连夜鉴定涉黄资料。

当时鉴黄师刘春琪一直工作了二十多天,才把那批资料鉴定完,期间还呕吐了很多次...

随着互联网发展,很多大厂也需要内容审核专员,去处理色情、暴力、涉政、恐怖等违法内容。

和鉴黄相似,但内容审核专业需要鉴别的内容更广。

这事儿干多了,心态真的很容易裂开。

于是乎,AI鉴黄这种技术应运而生。

无论用来做啥,AI的原理都是类似的,它需要大量数据去训练,直到能精准识别位置。

AI鉴黄也是如此,需要工程师投喂大量确认为“黄图”的图片,然后让AI不断学习和判断。

但即使是再成熟的AI,现在也很难完全取代人工审核。

因为关于“怎么样的图才是黄图”这事儿,压根就没有硬标准。

比如下面这张图,从咱们的视角来看,肯定不是黄图,毕竟冲浪板都把重要部位挡住了。

但在训练不佳的AI眼里,这位女生就是没有穿衣服,一律判定为搞黄色。

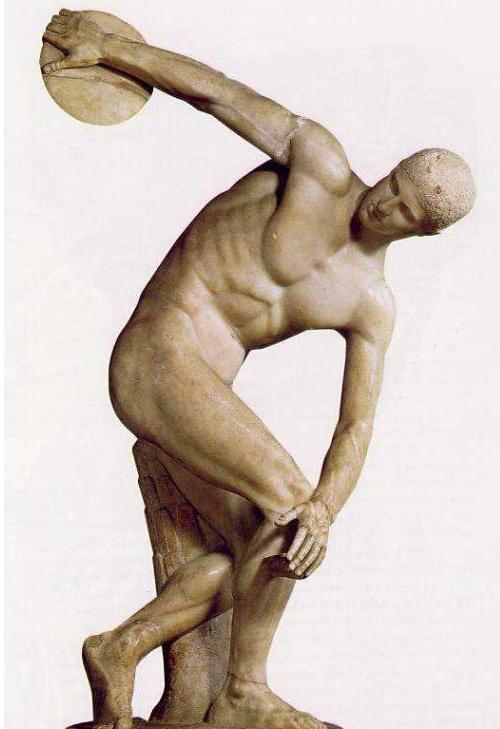

还有嚯,AI没有人的情感,它很难去完全判断一张图片到底是艺术还是黄色。

像这种希腊全裸雕像,总不能说就是在搞黄色吧?

除了标准难以界定,现在也有一些专门对抗AI鉴黄的AI技术出现。

没错,就是让AI来打败AI...

小雷以前也有提及过这项技术,它叫做「图像缩放攻击」。

这项技术的基本思路是将一些分辨率较低的图片隐藏在分辨率较大的图片中,大图分辨率大概是小图的5-10倍左右。

当这些图片经过AI审查或处理时,由于AI有自己的一套数据算法,一般都会把原图压缩成比较低的分辨率,再进行处理。

比如这种风景图,原图是1200*1250分辨率,通过OpenCV压缩后变成120*125分辨率。

当AI把图片压缩后,看到的图片就不是风景图了,而是一只会拆家的哈士奇......

这就导致,有些图片明明是黄图,但经过「图像缩放攻击」处理后,AI反正会把它识别为正常的图。

虽说这项技术也有破解的方法,但让AI相互打架,最终也很难得出什么结果啊。

按目前的形势来看,人工内容审核还是得有。

毕竟AI会思考,都是建立在数据量足够的基础上,只要有人“误导”一下,它就认不出东西来了。

现在我们能健康上网,还真得感谢那些抗压能力极强的的审核人员。

老规矩,想体验“在线黄图检测器”的小伙伴,在小雷哔哔公众号回复【655】获取。